首席情报官(Wiseflow)是一个敏捷的信息挖掘工具,可以从网站、微信公众号、社交平台等各种信息源中按设定的关注点提炼讯息,自动做标签归类并上传数据库。

我们缺的其实不是信息,我们需要的是从海量信息中过滤噪音,从而让有价值的信息显露出来!

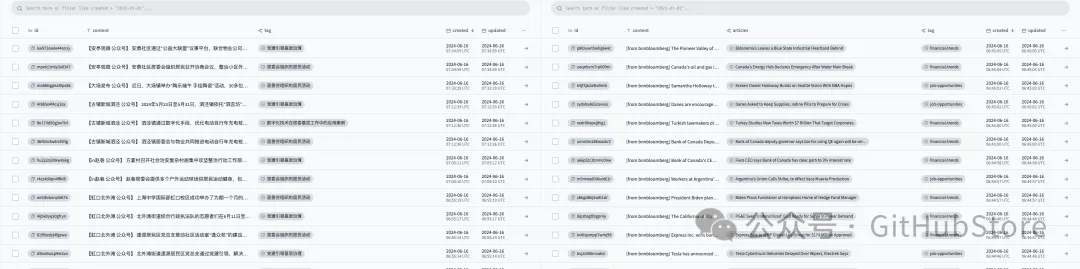

看看首席情报官是如何帮您节省时间,过滤无关信息,并整理关注要点的吧!

你可以轻松将它整合到任意 Agent 项目中作为动态知识库。

首席情报官对于硬件基本无要求,系统开销很小,无需独立显卡和CUDA(使用在线LLM服务的情况下)

克隆代码仓库

😄 点赞、fork是好习惯

git clone https://github.com/TeamWiseFlow/wiseflow.git

cd wiseflow

2. 强烈推荐使用docker 运行

中国区用户使用前请合理配置网络,或者指定docker hub镜像

docker compose up

可按需修改compose.yaml

注意:

在wiseflow代码仓根目录下运行上述命令;

运行前先创建并编辑.env文件放置在Dockerfile同级目录(wiseflow代码仓根目录),.env文件可以参考env_sample

第一次运行docker container时会遇到报错,这其实是正常现象,因为你尚未为pb仓库创建admin账号。

此时请保持container不关闭状态,浏览器打开http://127.0.0.1:8090/_/ ,按提示创建admin账号(一定要使用邮箱),然后将创建的admin邮箱(再次强调,一定要用邮箱)和密码填入.env文件,重启container即可。

如您想更改container的时区和语言【会决定prompt语言选择,但实测对呈现结果影响不大】,使用如下命令运行image

docker run -e.UTF-8 -e LC_CTYPE=zh_CN.UTF-8 your_image

3.【备选】直接使用python运行

conda create -n wiseflow python=3.10

conda activate wiseflow

cd core

pip install -r requirement.txt

之后可以通过core/scrips 中的脚本分别启动pb、task和backend (将脚本文件移动到core目录下)

注意:

📚 for developer, see /core/README.md for more

通过 pocketbase 访问获取的数据:

http://127.0.0.1:8090/_/ - Admin dashboard UI

http://127.0.0.1:8090/api/ - REST API

一定要先启动pb,task和backend是独立进程,先后顺序无所谓,也可以按需求只启动其中一个;

需要先去这里 https://pocketbase.io/docs/ 下载对应自己设备的pocketbase客户端,并放置在 /core/pb 目录下

pb运行问题(包括首次运行报错等)参考 core/pb/README.md

使用前请创建并编辑.env文件,放置在wiseflow代码仓根目录(core目录的上级),.evn文件可以参考env_sample,详细配置说明见下

配置

复制目录下的env_sample,并改名为.env, 参考如下 填入你的配置信息(LLM服务token等)

LLM_API_KEY # 大模型推理服务API KEY

LLM_API_BASE # 本项目依赖openai sdk,只要模型服务支持openai接口,就可以通过配置该项正常使用,如使用openai服务,删除这一项即可

WS_LOG="verbose" # 设定是否开始debug观察,如无需要,删除即可

GET_INFO_MODEL # 信息提炼与标签匹配任务模型,默认为 gpt-3.5-turbo

REWRITE_MODEL # 近似信息合并改写任务模型,默认为 gpt-3.5-turbo

HTML_PARSE_MODEL # 网页解析模型(GNE算法效果不佳时智能启用),默认为 gpt-3.5-turbo

PROJECT_DIR # 数据、缓存以及日志文件存储位置,相对于代码仓的相对路径,默认不填就在代码仓

PB_API_AUTH='email|password' # pb数据库admin的邮箱和密码(注意一定是邮箱,可以是虚构的邮箱)

PB_API_BASE # 正常使用无需这一项,只有当你不使用默认的pocketbase本地接口(8090)时才需要

模型推荐

经过反复测试(中英文任务),综合效果和价格,GET_INFO_MODEL、REWRITE_MODEL、HTML_PARSE_MODEL 三项我们分别推荐 "zhipuai/glm4-9B-chat"、"alibaba/Qwen2-7B-Instruct"、"alibaba/Qwen2-7B-Instruct"

它们可以非常好的适配本项目,指令遵循稳定且生成效果优秀,本项目相关的prompt也是针对这三个模型进行的优化。(HTML_PARSE_MODEL 也可以使用 "01-ai/Yi-1.5-9B-Chat",实测效果也非常棒)

⚠️ 同时强烈推荐使用 SiliconFlow 的在线推理服务,更低的价格、更快的速度、更高的免费额度!⚠️

SiliconFlow 在线推理服务兼容openai SDK,并同时提供上述三个模型的开源服务,仅需配置 LLM_API_BASE 为 "https://api.siliconflow.cn/v1" , 并配置 LLM_API_KEY 即可使用。

😄 或者您愿意使用我的邀请链接,这样我也可以获得更多token奖励 😄

关注点和定时扫描信源添加

启动程序后,打开pocketbase Admin dashboard UI (http://127.0.0.1:8090/_/)

6.1 打开 **tags表单**

通过这个表单可以指定你的关注点,LLM会按此提炼、过滤并分类信息。

tags 字段说明:

- name, 关注点描述,**注意:要具体一些**,好的例子是:`中美竞争动向`,不好的例子是:`国际局势`。

- activated, 是否激活。如果关闭则会忽略该关注点,关闭后可再次开启。开启和关闭无需重启docker容器,会在下一次定时任务时更新。

6.2 打开 **sites表单**

通过这个表单可以指定自定义信源,系统会启动后台定时任务,在本地执行信源扫描、解析和分析。sites 字段说明:- url, 信源的url,信源无需给定具体文章页面,给文章列表页面即可。- per_hours, 扫描频率,单位为小时,类型为整数(1~24范围,我们建议扫描频次不要超过一天一次,即设定为24)- activated, 是否激活。如果关闭则会忽略该信源,关闭后可再次开启。开启和关闭无需重启docker容器,会在下一次定时任务时更新。

https://github.com/TeamWiseFlow/wiseflow/blob/master/README_CN.md